Почему нельзя покупать видеокарту на будущее?

Любой разговор о покупке нового компьютера скорее всего быстро сведётся к вопросу о его сроке жизни. Выкладывая немалые деньги за обновление железа, все хотят удостовериться, что оно прослужит как можно дольше, особенно, если уже были случаи быстро потерявших актуальность или вообще сгоревших комплектующих.

Прежде чем мы углубимся в этот вопрос, необходимо установить несколько правил. Я провожу чёткую границу между покупкой необязательных на сегодняшний момент комплектующих, которые точно пригодятся в будущем, и добавлением к сборке компонентов со специфическим функционалом, на потенциал которого вы лишь надеетесь. Приведу пример.

Если вы покупаете видеокарту для 4K, потому что в ближайшие месяцы собираетесь поменять монитор, это не ставка на будущее. Если в 2021 вы меняете поколение Pascal на Ampere исключительно из-за веры в Рейтрейсинг, чтобы заполучить идеальную картинку, вот это – ставка на будущее. В первом случае вы принимаете решение на основе опубликованных тестов желаемой видеокарты в разных разрешениях и собственных чётких планов. Во втором случае вы рассчитываете, что технология без поддержки в множестве игр обеспечит решающее преимущество, не имея на то полноценных доказательств.

Примечание: В данной статье часто будут упоминаться видеокарты Nvidia, но не потому, что этот производитель виновен в провальности ставок на будущее. Последние десять лет видеокарты развиваются куда быстрее процессоров и для них анонсируется больше технических особенностей, повышающих производительность и качество изображения. В целом у Nvidia список таких особенностей шире, чем у AMD.

Вспомним распространённые заблуждения

RTX

Делает картинку лучше? Да, но не всегда и не везде. Разработчики игр все еще не готовы к полноценному использованию тензорных ядер. А если в игре и есть поддержка лучей, то вместе с этим вы рискуете получить порцию глюков.

Лукавство со стороны Nvidia заключается в том, что симуляцию большинства эффектов разработчики создавали с помощью PBR-текстур и просто грамотного дизайна уровней. Да, этот тип вычислений перспективный, но не в 2021 году.

Не стоит забывать, что у новых RTX видеокарт и CUDA ядер больше. Поэтому не пытаюсь отговаривать тех, кто имеет в запасе тысячу долларов на видеокарту.

История повторяется, вот вам несколько примеров.

DirectX 12

Сначала были надежды на то, что Maxwell в конце концов научится хорошо работать с DX12 или что Pascal будет эффективно его использовать, или что он быстро и решительно проявит себя в играх. Ни одна из них не оправдалась. Pascal неплохо дружит с DX12, но пользы от смены API не много, и не везде она вообще есть. У AMD результаты временами чуть лучше, однако DX12 не удалось добиться повсеместного распространения. В 2013 вы могли ставить на AMD, рассчитывая, что двойной удар от Mantle и консолей обеспечит команде красных внушительное превосходство, но такого не случилось. Ожидания, что Pascal станет архитектурой, способной продемонстрировать DX12 во всей красе (в отличие от Maxwell), аналогичным образом не оправдались.

Тут стоит уточнить, что маркетинг Nvidia никогда не указывал DX12 в качестве причины покупки новой видеокарты, как это сейчас происходит с RTX. На самом деле компания всеми законными способами игнорировала расспросы о поддержке асинхронных вычислений. Но это всё же не отменяет того факта, что не везде используемый и не всегда дающий преимущество DX12 (API с низкой задержкой в большинстве случаев повышают производительность слабых процессоров, а не видеокарт) – был не лучший повод для апгрейда в 2016.

DirectX 11

Помните времена, когда тесселяция обещала быть технологией, перевернувшей игры? Вместо этого мы либо получали скромные визуальные изменения за счёт приличных затрат производительности, либо наблюдали, как видеокарты AMD с большим трудом украшали плоские поверхности необязательным рельефом. Если вы тогда купили Nvidia, решив, будто производительность в синтетических тестах тесселяции сравнится с настоящими играми без нагромождений полигонов, то вы зря потратили свои деньги.

DirectX 10

Все ведь помнят поразительную производительность DX10?

Кто-нибудь помнит поразительную производительность DX10?

Хоть кто-нибудь?

Покупка видеокарты серии GTX 8xxx ради DX10 вела к разочарованию. Мы не можем сказать то же самое про AMD, но лишь потому, что разочарованными остались вообще все покупатели серии HD 2000. Когда первое поколение видеокарт с поддержкой DX10 оказалось неспособным использовать новый API на практике, были люди, делавшие ставку на следующее поколение очень быстрых DX9-видеокарт, в надежде на улучшенную совместимость в будущем. На деле же они получили устройства, не выдающие нормальный фреймрейт с API, поддержка которого была их ключевой особенностью.

Вот откуда пошёл мем «Can it play Crysis?»

Список не заканчивается на API, это лишь самый простой пример. Вы могли вложиться в новый компьютер ради первого поколения VR, чтобы во всеоружии встретить новую эру изумительных игр. Что ж, она до сих пор не наступила. А когда (если) наступит, вы уже успеете как минимум один раз поменять и шлем, и видеокарту. Покупая новую Nvidia с надеждой, что PhysX станет новым стандартом в игровой индустрии, вы не совсем прогадали: всё-таки это неплохая технология, просто преподносили её в то время как революционную. Мне PhysX понравилась – да и сейчас нравится – но игры могут прекрасно обходиться и без неё.

И проблема не сводится к видеокартам. Если вы купили гибридный процессор AMD, думая, будто архитектура HSA (Heterogeneous System Architecture) станет новой парадигмой объединённых вычислений процессора и видеокарты – вам всё ещё приходится этого дожидаться спустя семь лет. Инновации вроде TSX (Transaction Synchronization Extensions) от Intel обещали найти себе применение в коммерческом софте, на это якобы просто требовалось время. Прошло почти десять лет и технология будто испарилась. Я смог найти всего лишь одно недавнее упоминание использования TSX в потребительском продукте. Как выяснилось, она оказалась чрезвычайно полезной для повышения производительности RPCS3, эмулятора PS3. Замечательно! Но для большинства людей явно не причина для покупки. Несколько лет назад Intel добавила поддержку Raster Order Views, однако если от этого выиграла хоть одна игра, я о таком не слышал (впрочем, оптимизация игровой производительности при помощи видеокарт Intel – вообще не самая популярная тема).

Вы можете решить, что всё дело в замедлившемся выходе новых архитектур, но это уж точно не так. Во времена, когда Nvidia обновляла архитектуру ежегодно, вероятность втискивания какой-то функции ради демонстрации сомнительных преимуществ была ещё плачевнее. Видеокарты становились почти вдвое мощнее, и покупать модель 2003 года ради игры, выходящей только в 2004, было откровенной глупостью. Как раз с такой проблемой и столкнулась Nvidia, кода выходила Half-Life 2. В 2003 Гейб Ньюэлл вышел на сцену и представил HL2 – и тут же серия GeForce FX смялась, как пивная банка.

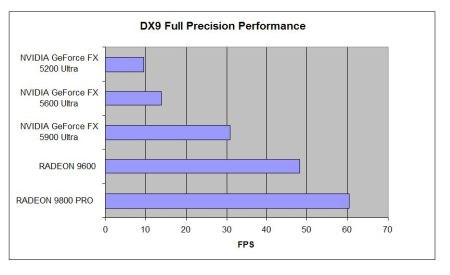

Осмелюсь заявить, что этот график сделал для видеокарт ATI больше, чем любая рекламная кампания. FX 5900 Ultra была флагманом своей линейки. Radeon 9600 – моделью среднего уровня.

Ньюэлл соврал, убедив всех, что до релиза игры осталось лишь несколько месяцев, и народ бросился скупать видеокарты ATI. В итоге выяснилось, что до релиза оставался целый год, и к тому времени вышло куда более производительное семейство GeForce 6xxx. К тому же, появилось новое поколение видеокарт ATI с поддержкой PCI Express. В тот раз проиграли абсолютно все, кто ставил на будущее.

Гейб Ньювел во времена работы над Half-Life 2

Сложившейся тенденции противоречит всего один случай, и я сразу о нём расскажу: это DirectX 12 и асинхронные вычисления. В 2012-2013 для видеокарт AMD Hawaii эта связка действительно оказывалась полезной, соответственно, можно говорить о некоторой оправданности вложений.

Однако, это всё же слабый пример. Во-первых, улучшения наблюдались лишь в играх с поддержкой и DX12, и асинхронных вычислений. Во-вторых, прирост производительности не был равномерным у всей линейки моделей – старшие видеокарты проявляли себя лучше. В-третьих, отчасти, причина прироста кроется в том, что драйвер AMD для DX11 был многопоточным. И в-четвёртых, скромного увеличения производительности ряда моделей на техпроцессе 28 нм было недостаточно ни для общей конкурентоспособности линейки, ни для выгодности дальнейшего их производства в сравнении с последующими видеокартами на техпроцессе 14-16 нм (вопрос устаревания комплектующих относительно рынка уместен в зависимости от того, затрагивает ли ваша ставка на будущее весь компьютер).

Разумеется, здорово, что владельцы 28-нанометровых моделей AMD получили выгоду от DirectX 12 и Vulkan. Но признавать это нужно наряду с тем, что игр с их поддержкой за последние годы вышло мало. Возможно, эти API в будущем станут доминирующими, но видеокарты 2016 года к тому моменту наверняка устареют.

Оптимизация затрат

Во-первых, если вы хотите получить максимум за свои деньги, не размышляйте, как будут развиваться технологии в следующие 24-48 месяцев. Вместо этого оценивайте текущую производительность доступных на рынке моделей. Когда дело касается нового функционала, думайте, что будет полезно для вас сразу после покупки, а не о том, что, быть может, пригодится в будущем. Игровые релизы могут переноситься, технологии могут не оправдать себя – выстраивайте своё решение на основе того, что можете опробовать на данный момент. Если вы не восторге от нынешней производительности планируемого апгрейда, не тратьте на него деньги.

Во-вторых, разберитесь в ценовой политике компаний и в стоимости заявленных особенностей новинок. Очевидно, что у разных производителей и на разных рынках всё будет несколько отличаться, но в любом случае это важный момент. В низком и среднем ценовом сегменте видеокарт AMD и Nvidia, как правило, выставляют ценник соответственно производительности. Если модель на 10 % мощнее, стоить она будет на 10 % дороже. У дорогих видеокарт прирост цены повышается: за 10 лишних процентов производительности просят уже на 20 % больше. С появлением новых линеек прежние флагманы опускаются в средний сегмент, и их цена падает. GTX 1060 и GTX 980 стали отличным примером случая, когда за гораздо меньшие деньги можно было купить среднюю видеокарту с производительностью топовой модели двухлетней давности.

Избежать разочарований можно, покупая только то, что пригодится уже сегодня

В-третьих, планируйте даты покупок, исходя из циклов производства. Иногда лучшим вариантом будет недавно подешевевший представитель прошлого поколения. Иногда имеет смысл взять новинку за те же деньги или подороже. Даже мой пример с чёткими планами насчёт будущих покупок может стать проблемой, если вы не следите за рынком. Любой, кто потратил $1700 на Core i7-6950X в феврале 2017 вряд ли был рад появлению Core i9-7900X с теми же 10 ядрами и лучшей производительностью всего за $999 спустя несколько месяцев. Не говоря уже о дыре, которую в семействе Intel HEDT пробили процессоры Threadripper, предлагавшие 16 ядер вместо 10 за те же деньги.

Дженсен Хуанг анонсирует поколение Ampere

И, наконец, помните: маркетинговые отделы буквально работают над тем, чтобы убедить вас в умопомрачительности и невероятной важности новых технологий, необходимых вам прямо сейчас. На практике всё не так просто, и новому функционалу нужно время, чтобы прижиться в индустрии. Учитывая замедлившийся нынче темп обновлений компьютерных комплектующих, на распространение технологий до уровня стандартных может потребоваться до 3-5 лет.

Цены на момент публикации:

- RTX 3070 стоит 130000 рублей

- RTX 3060 много предлагают за 75000 рублей

- GTX 1650 можно найти за 18500 рублей

- Radeon RX 6900 всего за 139000 рублей

Не самая приятная ситуация. Советы выше сейчас не работают, данную аномалию можно только переждать.

Ничего не меняется

Линейка Nvidia RTX 3000, вышедшая осенью 2020 существенно увеличила производительность трассировки лучей и соотношение цена/быстродействие в сравнении с поколением Turing. Когда Nvidia представляла архитектуру Turing, компания заявляла, что новинки откроют путь в удивительный мир роскошных игр с рейтрейсингом. В итоге за время, что Turing главенствовала на рынке, вышло очень мало игр с поддержкой новой технологии, и именно в них видеокарты Ampere теперь демонстрируют наибольшее преимущество над Turing.

Нет ничего плохого в желании купить дорогую видеокарту, когда хочется приобрести самое лучшее. Нет ничего плохого в покупке топовой модели, если требуется максимум возможной производительности, пусть и по невыгодной цене. Однако всем, кто взял RTX 2080 Ti ради игр с рейтрейсингом, в 2018 стоило оставаться на Pascal, а в 2020-2021 брать сразу Ampere (главное суметь их найти).

ProGamer

ProGamer